06/03/2024

En el vasto universo de la modelización de sistemas complejos, especialmente aquellos que evolucionan a lo largo del tiempo con cierto grado de incertidumbre, las herramientas matemáticas juegan un papel fundamental. Un modelo puede ser definido como un esquema teórico, a menudo expresado matemáticamente, que busca simplificar una realidad compleja para facilitar su comprensión y el estudio de su comportamiento. Estos modelos son esenciales en diversas áreas, desde la física hasta la economía, pasando por la biología y, como veremos, la salud. En este contexto, una herramienta particularmente poderosa y ampliamente utilizada es la de las Cadenas de Markov, nombradas en honor al matemático ruso Andrei Andreyevich Markov.

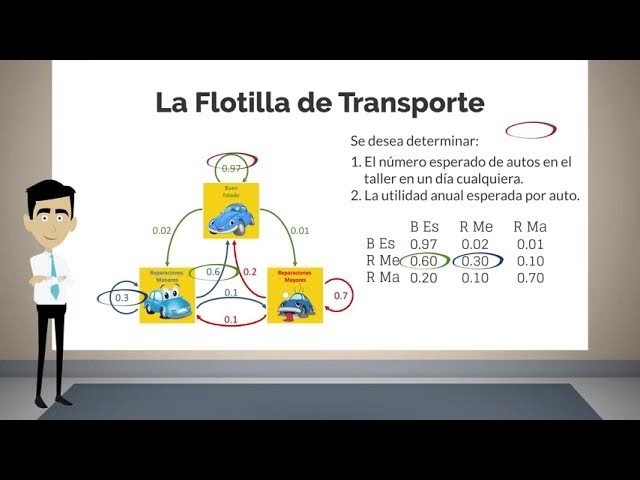

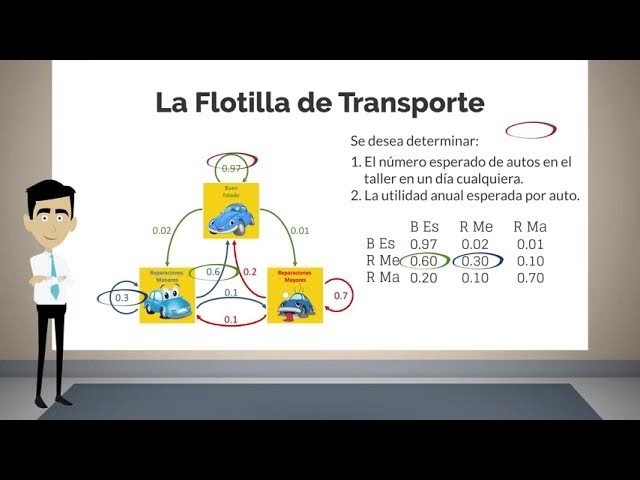

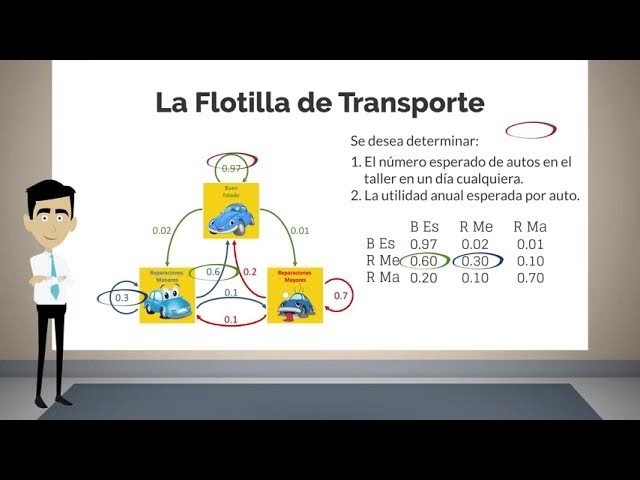

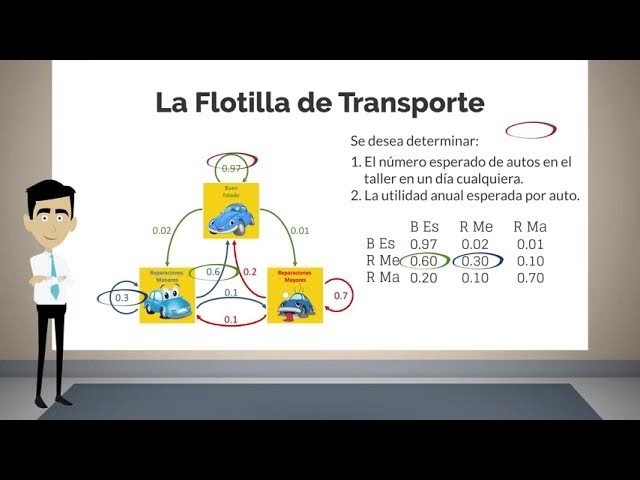

![Una agencia de renta de automóviles tiene oficinas en Phoenix, Denver, Chicago y Atlanta [SOLUCIÓN].](https://i.ytimg.com/vi/UNqlVuh23qo/hqdefault.jpg)

Las Cadenas de Markov son un tipo específico de proceso estocástico, es decir, un proceso cuya evolución futura está determinada por factores aleatorios. Lo que las distingue es una propiedad fundamental conocida como la propiedad de Markov.

- Definición de Cadena de Markov

- Características Clave de las Cadenas de Markov

- Cadenas Homogéneas y No Homogéneas

- Probabilidades de Transición

- Matriz de Probabilidades de Transición

- Ecuación de Chapman-Kolmogorov

- Clases de Comunicación y Irreducibilidad

- Periodicidad

- Tiempos y Probabilidades de Primera Visita

- Recurrencia y Transitoriedad

- Tiempo Medio de Recurrencia

- Distribuciones Estacionarias

- Existencia, Unicidad y Convergencia

- Tipos de Cadenas de Markov

- Aplicaciones: Modelos Farmacoeconómicos

- Ejemplos Prácticos en Farmacoeconomía

- Preguntas Frecuentes sobre Cadenas de Markov

Definición de Cadena de Markov

Formalmente, una Cadena de Markov es un proceso estocástico a tiempo discreto, denotado por { Xn: n = 0, 1, 2… }. Este proceso tiene un espacio de estados discreto S, que representa los posibles 'estados' en los que se puede encontrar el sistema en cada momento. La característica definitoria, la propiedad de Markov, establece que la probabilidad de que el proceso se encuentre en un estado futuro depende únicamente del estado actual, y no de cómo llegó a ese estado. Matemáticamente, para cualquier entero n ≥ 0 y para cualesquiera estados x₀, x₁, …, xn+1 en S, se cumple:

P[Xn+1 = xn+1 | X₀ = x₀, X₁ = x₁, …, Xn = xn] = P[Xn+1 = xn+1 | Xn = xn]

Esta propiedad de 'falta de memoria' es lo que simplifica el análisis de estos procesos y permite su aplicación en una amplia gama de situaciones donde el pasado distante no influye directamente en el futuro inmediato, una vez conocido el presente.

Características Clave de las Cadenas de Markov

Para comprender a fondo las Cadenas de Markov, es crucial conocer sus características principales:

Cadenas Homogéneas y No Homogéneas

Una Cadena de Markov se considera homogénea si la probabilidad de pasar del estado i al estado j en un paso no varía con el tiempo. Es decir, la probabilidad de transición es constante a lo largo del tiempo. Si esta probabilidad cambia con el tiempo n para alguna pareja de estados, la cadena es no homogénea.

Probabilidades de Transición

Para dos estados i y j, la Probabilidad de Transición de ir del estado i en el tiempo n al estado j en el tiempo n+1 se denota por pij(n, n+1) = P[Xn+1 = j | Xn = i]. Cuando la cadena es homogénea, esta probabilidad se simplifica a pij = P[Xn+1 = j | Xn = i], representando la probabilidad de pasar de i a j en una unidad de tiempo. Estas probabilidades son fundamentales y suelen venir dadas por números reales entre 0 y 1. Si no se conocen con precisión, deben estimarse, lo que introduce incertidumbre.

Matriz de Probabilidades de Transición

El conjunto de todas las probabilidades de transición en un paso pij para todos los estados i y j se organiza en una Matriz de Transición P. Si el espacio de estados S es {0, 1, 2, …}, la matriz P es:

P =

[ p₀₀ p₀₁ p₀₂ … ]

[ p₁₀ p₁₁ p₁₂ … ]

[ p₂₀ p₂₁ p₂₂ … ]

[ ⋮ ⋮ ⋮ ]

La entrada (i, j) de esta matriz es pij. P es una matriz estocástica, lo que significa que todas sus entradas son no negativas (pij ≥ 0) y la suma de las entradas en cada fila es igual a 1 ( ∑j∈S pij = 1 para cada i). De manera similar, se define P(n) como la matriz de probabilidades de transición en n pasos, donde la entrada (i, j) es pij(n), la probabilidad de ir de i a j en n pasos.

Ecuación de Chapman-Kolmogorov

Esta ecuación es una propiedad fundamental que relaciona las probabilidades de transición en diferentes intervalos de tiempo. Para cualesquiera r, n ≥ 0 y estados i, j, se cumple: pij(n) = ∑k∈S pik(r) pkj(n-r). Una consecuencia crucial es que la matriz de transición en n pasos, P(n), es simplemente la n-ésima potencia de la matriz de transición en un paso, P: P(n) = Pn. Esto simplifica enormemente el cálculo de probabilidades a largo plazo.

Clases de Comunicación y Irreducibilidad

Dos estados i y j se comunican (i ↔ j) si es posible ir de i a j y de j a i en un número finito de pasos. Esta relación divide el espacio de estados S en clases de comunicación. Una cadena se dice irreducible si todos los estados se comunican entre sí, es decir, si solo hay una clase de comunicación que abarca todo el espacio de estados (C(i) = S para todo i).

Periodicidad

El periodo de un estado i, d(i), es el máximo común divisor de todas las longitudes n de caminos posibles que empiezan y terminan en i. Si d(i) = 1, el estado es aperiódico. Si d(i) > 1, es periódico. Una cadena es aperiódica si todos sus estados son aperiódicos.

Tiempos y Probabilidades de Primera Visita

Se define τC como el primer tiempo n > 0 en que la cadena entra en un conjunto de estados C. La probabilidad de primera visita fij(n) es la probabilidad de ir del estado i al estado j por primera vez en n pasos. La probabilidad fij = ∑n=1∞ fij(n) es la probabilidad de una eventual visita a j partiendo de i.

Recurrencia y Transitoriedad

Un estado i es recurrente si, partiendo de i, la probabilidad de regresar eventualmente a i es 1 (fii = 1). Equivalentemente, si la suma infinita de las probabilidades de regresar a i en n pasos diverge (∑n=1∞ pii(n) = ∞). Un estado es transitorio si la probabilidad de regresar es menor que 1 (fii < 1), o si la suma infinita converge (∑n=1∞ pii(n) < ∞). La recurrencia es una propiedad de clase: si un estado es recurrente, todos los estados en su misma clase de comunicación también lo son.

Tiempo Medio de Recurrencia

Para un estado recurrente j, el tiempo medio de recurrencia μij es la esperanza del tiempo de primera visita a j partiendo de i. Si i=j, μi es el tiempo medio para regresar a i. Un estado recurrente i es recurrente nulo si μi = ∞, y recurrente positivo si μi < ∞. La recurrencia positiva también es una propiedad de clase.

Distribuciones Estacionarias

Una distribución de probabilidad π = (π₀, π₁, …) es estacionaria para una cadena de Markov si πj = ∑i∈S πi pij para todo j, o en forma matricial, π = πP. Esto significa que si la distribución inicial de la cadena es π, la distribución en cualquier tiempo futuro n también será π. Las distribuciones estacionarias son cruciales para entender el comportamiento a largo plazo de la cadena.

Existencia, Unicidad y Convergencia

Si una Cadena de Markov es irreducible y recurrente positiva, entonces tiene una única Distribución Estacionaria, dada por πj = 1 / μj. Además, si la cadena es irreducible, recurrente positiva y aperiódica, las probabilidades de transición pij(n) convergen a la distribución estacionaria a medida que n tiende a infinito: limn→∞ pij(n) = πj. Esto implica que, después de mucho tiempo, la probabilidad de estar en un estado j tiende a un valor fijo πj, independientemente del estado inicial i.

Tipos de Cadenas de Markov

Basándose en las propiedades anteriores, se clasifican las Cadenas de Markov:

- Cadenas Irreducibles: Todos los estados se comunican entre sí. El único conjunto cerrado es el espacio total de estados S.

- Cadenas Recurrentes Positivas: Todos sus estados son recurrentes positivos. Si además es irreducible, existe un único vector de probabilidad invariante (la distribución estacionaria).

- Cadenas Regulares (Primitivas o Ergódicas): Existe alguna potencia positiva de la matriz de transición cuyas entradas son todas estrictamente mayores que cero. Para cadenas con espacio de estados finito, esto garantiza la convergencia a una única distribución estacionaria, donde Pn tiende a una matriz con todas las filas iguales al vector de la distribución estacionaria.

- Cadenas Absorbentes: Tienen al menos un estado absorbente (del que no se puede salir) y desde cualquier estado no absorbente se puede llegar a un estado absorbente. La matriz de transición de una cadena absorbente finita puede reordenarse en una forma canónica.

- Cadenas de Markov a Tiempo Continuo: A diferencia de las de tiempo discreto, el tiempo varía en un intervalo continuo. La propiedad de Markov se mantiene, adaptada a este contexto temporal. Para cadenas finitas y homogéneas, la matriz de transición P(t) para un tiempo t > 0 puede derivarse de un 'generador infinitesimal' Q mediante la exponencial de matriz: P(t) = eQt.

Aplicaciones: Modelos Farmacoeconómicos

Aunque las Cadenas de Markov tienen aplicaciones en innumerables campos, el texto proporcionado se centra en su uso en Modelos Farmacoeconómicos. Estos modelos son cruciales para evaluar la eficiencia (coste por unidad de efectividad) de diferentes alternativas terapéuticas o preventivas, como los fármacos. Permiten simular realidades complejas como los procesos sanitarios, combinando datos de eficacia con estimaciones de la práctica clínica, consumo de recursos y costes.

En la evaluación económica sanitaria, se distinguen modelos determinísticos y estocásticos. Los modelos determinísticos asumen certeza en los datos y usan valores medios directamente. Los modelos estocásticos, en cambio, incorporan la incertidumbre y utilizan la aleatorización para simular la distribución probabilística de los eventos. El modelo estocástico más usado es el modelo de Markov.

Un modelo de Markov aplicado a la salud asume que un paciente se encuentra siempre en uno de un número finito de estados de salud (estados de Markov) que son exhaustivos y mutuamente excluyentes. Estos estados pueden ser absorbentes (como la muerte) o no absorbentes. Los eventos se modelan como transiciones entre estados que ocurren en períodos de tiempo uniformes (ciclos de Markov), con probabilidades de transición que dependen del estado actual.

Los modelos de Markov son especialmente útiles para modelar enfermedades crónicas, donde los eventos son repetitivos, irreversibles y de larga duración. Permiten simular la evolución de la enfermedad de una manera más "realista" que los modelos determinísticos simples.

Sin embargo, presentan inconvenientes. La principal es la suposición markoviana, la falta de memoria. Se asume que el pronóstico futuro de un paciente depende solo de su estado actual, no de su historial previo. Esto no siempre se ajusta a la realidad de muchas enfermedades. Además, en modelos muy complejos, puede ser difícil obtener datos fiables para todas las probabilidades de transición.

Dentro de los modelos de Markov aplicados a la salud, se distingue entre:

- Cadenas de Markov: Las probabilidades de transición permanecen constantes a lo largo de toda la simulación. Son aplicables a problemas con un horizonte temporal corto.

- Procesos de Markov: Las probabilidades de transición varían con el tiempo (por ejemplo, con la edad del paciente). Son más adecuados para enfermedades crónicas de larga duración, aunque requieren datos de tasas de morbilidad/mortalidad fiables por intervalos de tiempo.

Los pasos para elaborar un modelo de Markov incluyen definir los estados de salud, establecer las transiciones permitidas, definir la duración de los ciclos, fijar las probabilidades de transición, determinar la utilidad y los costes de cada estado, y finalmente, resolver la simulación. La resolución puede hacerse simulando una cohorte hipotética, usando simulación de Monte Carlo (simulación individual de muchos pacientes) o mediante matrices fundamentales (solo para cadenas).

Ejemplos Prácticos en Farmacoeconomía

Ejemplo Teórico: Vacunación

Consideremos un ejemplo simple de una Cadena de Markov para evaluar la eficiencia de una vacuna. Los estados posibles son: Salud, Enfermedad y Muerte. La Muerte es un estado absorbente. Una cohorte hipotética de individuos comienza en el estado 'Salud'. Las transiciones permitidas son de Salud a Salud, Salud a Enfermedad, Salud a Muerte; y de Enfermedad a Enfermedad, Enfermedad a Muerte. El ciclo de Markov es de un año, y la simulación se realiza durante cinco ciclos.

Las probabilidades de transición son constantes en cada ciclo, como se muestra en la Tabla 1:

| Hasta | Salud | Enfermedad | Muerte |

|---|---|---|---|

| Con vacunación | |||

| Desde: Salud | 0,6 | 0,2 | 0,2 |

| Desde: Enfermedad | 0 | 0,6 | 0,4 |

| Desde: Muerte | 0 | 0 | 1 |

| Sin vacunación | |||

| Desde: Salud | 0,4 | 0,3 | 0,3 |

| Desde: Enfermedad | 0 | 0,6 | 0,4 |

| Desde: Muerte | 0 | 0 | 1 |

Con estas probabilidades, se puede simular la evolución de una cohorte de 1.000 individuos. La Tabla 2 muestra el número de individuos en cada estado al final de cada ciclo:

| Ciclo (año) | Estado de salud | Total | Salud | Enfermedad | Muerte |

|---|---|---|---|---|---|

| 0 | Vacunados | 1.000 | 1.000 | 0 | 0 |

| 1 | Vacunados | 1.000 | 600 | 200 | 200 |

| 2 | Vacunados | 1.000 | 360 | 240 | 400 |

| 3 | Vacunados | 1.000 | 216 | 216 | 568 |

| 4 | Vacunados | 1.000 | 130 | 173 | 698 |

| 5 | Vacunados | 1.000 | 78 | 130 | 793 |

| 0 | No vacunados | 1.000 | 1.000 | 0 | 0 |

| 1 | No vacunados | 1.000 | 400 | 300 | 300 |

| 2 | No vacunados | 1.000 | 160 | 300 | 540 |

| 3 | No vacunados | 1.000 | 64 | 228 | 708 |

| 4 | No vacunados | 1.000 | 26 | 156 | 818 |

| 5 | No vacunados | 1.000 | 10 | 101 | 888 |

Al final de 5 años, la cohorte vacunada tiene más individuos sanos (78 vs 10) y menos fallecimientos (793 vs 888). Para el análisis económico, se asignan costes y utilidades (por ejemplo, Años de Vida Ajustados por Calidad - AVAC) a cada estado. Por ejemplo: Salud (1.000 UM, 1 AVAC), Enfermedad (100.000 UM, 0,7 AVAC), Muerte (500 UM, 0 AVAC). El análisis coste-utilidad se obtiene "plegando" el árbol de decisiones (multiplicando costes/utilidades por probabilidades).

La Tabla 3 muestra los resultados del análisis coste-utilidad:

| Estrategia | Costes (UM) | Utilidades (AVAC) | Coste/utilidades (UM/AVAC) |

|---|---|---|---|

| Vacunación | 624.625 | 2,374 | 263.156 |

| No vacunación | 624.208 | 1,540 | 405.216 |

| Diferencia | 417 | 0,834 | -142.060 |

| A. coste-utilidad incremental | La estrategia de vacuna domina a la estrategia de no vacunar | ||

En este caso, la estrategia de vacunación es más efectiva (0,834 AVAC más) y ligeramente más costosa (417 UM más) en este ejemplo. Sin embargo, en la terminología farmacoeconómica, si una alternativa es más efectiva y menos costosa, se dice que "domina" a la otra. Si es más efectiva y más costosa, se calcula el ratio coste-efectividad incremental (coste adicional / efectividad adicional). En este ejemplo particular, la diferencia de costes es muy pequeña en comparación con la diferencia de utilidades, y el texto concluye que la vacunación "domina" (aunque los números de la tabla sugieren que es más costosa, la conclusión del texto podría basarse en un error o una interpretación específica no detallada, o quizás la diferencia de coste es considerada despreciable en el contexto). Basándonos estrictamente en los números de la tabla, la vacunación es más costosa y más efectiva, por lo que se calcularía un ratio incremental de 417 / 0.834 ≈ 500 UM/AVAC. La conclusión de "domina" en el texto podría ser una simplificación o error en la fuente, pero seguiremos la fuente: la estrategia de vacuna domina a la de no vacunar.

Ejemplo de Proceso de Markov: Terapia Hormonal Sustitutiva (THS)

Un ejemplo de Proceso de Markov en farmacoeconomía es la evaluación de la Terapia Hormonal Sustitutiva (THS) en mujeres postmenopáusicas. Aquí, las probabilidades de transición varían con la edad, lo que lo convierte en un proceso no homogéneo. Los estados de salud pueden incluir: Salud, Fractura de Cadera (FC), Cardiopatía Isquémica (CI), Accidente Cerebrovascular (ACV), Cáncer de Mama (CM), Secuelas de FC, Secuelas de CI, Secuelas de ACV, volver a buena salud tras complicación (Salud 2), y Muerte (estado absorbente).

Las transiciones ocurren anualmente. Las probabilidades de transición se basan en los riesgos relativos de padecer estas complicaciones, que varían con la edad. La Tabla 4 muestra un ejemplo de riesgos relativos para mujeres con THS en comparación con no tratadas, por intervalos de edad:

| Edad en años | 50-54 | 55-59 | 60-64 | 65-69 | 70-74 | 75-79 | 80-84 | 85-89 | 90-94 | 95-99 |

|---|---|---|---|---|---|---|---|---|---|---|

| Fractura de cadera | 0,80 | 0,40 | 0,40 | 0,40 | 0,40 | 0,80 | 1,00 | 1,00 | 1,00 | 1,00 |

| Cardiopatía isquémica | 1,00 | 0,88 | 0,75 | 0,8 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 |

| Enfermedad cerebrovascular | 1,00 | 0,94 | 0,88 | 0,88 | 0,94 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 |

| Cáncer de mama | 1,00 | 1,00 | 1,30 | 1,30 | 1,30 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 |

La Tabla 5 muestra un ejemplo de probabilidades de transición anuales desde el estado "Salud" para mujeres con y sin THS, calculadas para diferentes intervalos de edad:

| Estado de salud un año después | Edad | Salud | FC | CI | ACV | CM | Muerte |

|---|---|---|---|---|---|---|---|

| Sin THS | 50-54 | 0,99485 | 0,00008 | 0,00091 | 0,00059 | 0,00235 | 0,00122 |

| 55-59 | 0,99043 | 0,00021 | 0,00286 | 0,00181 | 0,00275 | 0,00194 | |

| 60-64 | 0,98900 | 0,00046 | 0,00286 | 0,00181 | 0,00275 | 0,00312 | |

| 65-69 | 0,98109 | 0,00111 | 0,00546 | 0,00445 | 0,00259 | 0,00530 | |

| 70-74 | 0,97441 | 0,00298 | 0,00546 | 0,00445 | 0,00259 | 0,01011 | |

| 75-79 | 0,94004 | 0,00548 | 0,00915 | 0,01464 | 0,00183 | 0,02886 | |

| 80-84 | 0,91816 | 0,01491 | 0,00915 | 0,01464 | 0,00183 | 0,04131 | |

| 85-89 | 0,88288 | 0,02077 | 0,00915 | 0,01464 | 0,00183 | 0,07073 | |

| 90-94 | 0,87869 | 0,02496 | 0,00915 | 0,01464 | 0,00183 | 0,07073 | |

| 95-99 | 0,87713 | 0,02652 | 0,00915 | 0,01464 | 0,00183 | 0,07073 | |

| Con THS | 50-54 | 0,99482 | 0,00006 | 0,00091 | 0,00059 | 0,00235 | 0,00127 |

| 55-59 | 0,99092 | 0,00008 | 0,00252 | 0,00170 | 0,00275 | 0,00203 | |

| 60-64 | 0,98931 | 0,00018 | 0,00215 | 0,00159 | 0,00358 | 0,00319 | |

| 65-69 | 0,98327 | 0,00044 | 0,00410 | 0,00392 | 0,00337 | 0,00490 | |

| 70-74 | 0,97683 | 0,00119 | 0,00480 | 0,00418 | 0,00337 | 0,00963 | |

| 75-79 | 0,94946 | 0,00438 | 0,00733 | 0,01173 | 0,00183 | 0,02527 | |

| 80-84 | 0,92708 | 0,01491 | 0,00733 | 0,01173 | 0,00183 | 0,03712 | |

| 85-89 | 0,89204 | 0,02077 | 0,00733 | 0,01173 | 0,00183 | 0,06630 | |

| 90-94 | 0,88811 | 0,02496 | 0,00733 | 0,01173 | 0,00183 | 0,06604 | |

| 95-99 | 0,88665 | 0,02652 | 0,00733 | 0,01464 | 0,00183 | 0,06604 |

*FC: fractura de cadera. CI: cardiopatía isquémica. ACV: accidente cerebrovascular. CM: cáncer de mama.

Al igual que en el ejemplo anterior, cada estado de salud tendría asociados costes y utilidades anuales. La resolución de estos modelos, especialmente con probabilidades variables, requiere software estadístico para manejar la complejidad de los cálculos a lo largo del tiempo.

Preguntas Frecuentes sobre Cadenas de Markov

- ¿Qué son las Cadenas de Markov?

- Son procesos estocásticos a tiempo discreto donde la probabilidad de pasar a un estado futuro solo depende del estado actual, no de la secuencia de estados anteriores. Tienen la propiedad de "falta de memoria".

- ¿Qué es un modelo de Cadena de Markov?

- Es una representación matemática de un sistema que evoluciona en el tiempo a través de una serie de estados discretos, donde las transiciones entre estados se rigen por probabilidades que cumplen la propiedad de Markov.

- ¿Qué tipo de proyecciones se pudieran tomar con cadena de Markov?

- Se pueden proyectar las probabilidades de estar en cada estado en cualquier momento futuro (P(n) = P^n), calcular la probabilidad de eventual llegada a un estado, el tiempo medio para llegar a un estado, y determinar la distribución de probabilidad a largo plazo (distribución estacionaria) si la cadena cumple ciertas propiedades (irreducibilidad, recurrencia positiva, aperiodicidad).

- ¿Qué es la propiedad de Markov?

- Es la propiedad fundamental de una Cadena de Markov que establece que el futuro del proceso depende solo de su estado presente, siendo independiente de la historia pasada.

- ¿Qué es una matriz de transición?

- Es una matriz cuyas entradas pij representan la probabilidad de pasar directamente del estado i al estado j en un solo paso. La suma de las probabilidades en cada fila es 1.

- ¿Qué es una distribución estacionaria?

- Es una distribución de probabilidad sobre los estados de la cadena que no cambia con el tiempo. Si la cadena comienza en esta distribución, permanecerá en ella en todos los pasos futuros. Representa el comportamiento a largo plazo de la cadena en condiciones de convergencia.

- ¿Por qué se usan modelos de Markov en farmacoeconomía?

- Son útiles para modelar la evolución de enfermedades crónicas donde los pacientes pasan por diferentes estados de salud a lo largo del tiempo. Permiten incorporar la incertidumbre y simular el proceso de manera más realista que los modelos determinísticos.

- ¿Cuál es la diferencia entre una Cadena de Markov y un Proceso de Markov en salud?

- En una Cadena de Markov (homogénea), las probabilidades de transición entre estados son constantes a lo largo del tiempo. En un Proceso de Markov (no homogéneo), estas probabilidades pueden variar, típicamente con el tiempo o la edad del paciente, lo que los hace más adecuados para modelar enfermedades de larga duración donde el riesgo cambia con el tiempo.

Si quieres conocer otros artículos parecidos a Cadenas de Markov: Conceptos y Aplicaciones puedes visitar la categoría Automóviles.